Claude Code lancia gli Agent Teams: quando l'AI smette di essere uno strumento e diventa un collega

Fino a oggi, quando pensavamo all'AI come assistente di sviluppo, l'immagine mentale era chiara: un singolo agente intelligente a cui delegare compiti, uno strumento sofisticato ma comunque uno strumento.

Gli Agent Teams di Claude Code scardinano questa concezione introducendo qualcosa di radicalmente diverso: una struttura organizzativa vera e propria, dove multiple istanze di Claude collaborano, si coordinano, comunicano tra loro e gestiscono autonomamente task complessi.

Ciò che rende questa innovazione particolarmente significativa non è tanto la capacità tecnica di far girare più sessioni contemporaneamente, quanto l'architettura concettuale sottostante. Abbiamo un team lead che coordina il lavoro, assegna compiti e sintetizza risultati, affiancato da teammate che operano indipendentemente, ciascuno nel proprio contesto, ma con la capacità di comunicare direttamente tra loro. È un modello che replica fedelmente le dinamiche di un team umano, con tutto ciò che questo comporta in termini di efficienza ma anche di complessità.

La distinzione cruciale: Agent Teams vs Subagents

Per comprendere appieno l'innovazione degli Agent Teams, è fondamentale confrontarli con i subagents, un'altra modalità di parallelizzazione già disponibile. La differenza non è banale e rivela molto sulla filosofia progettuale di Anthropic.

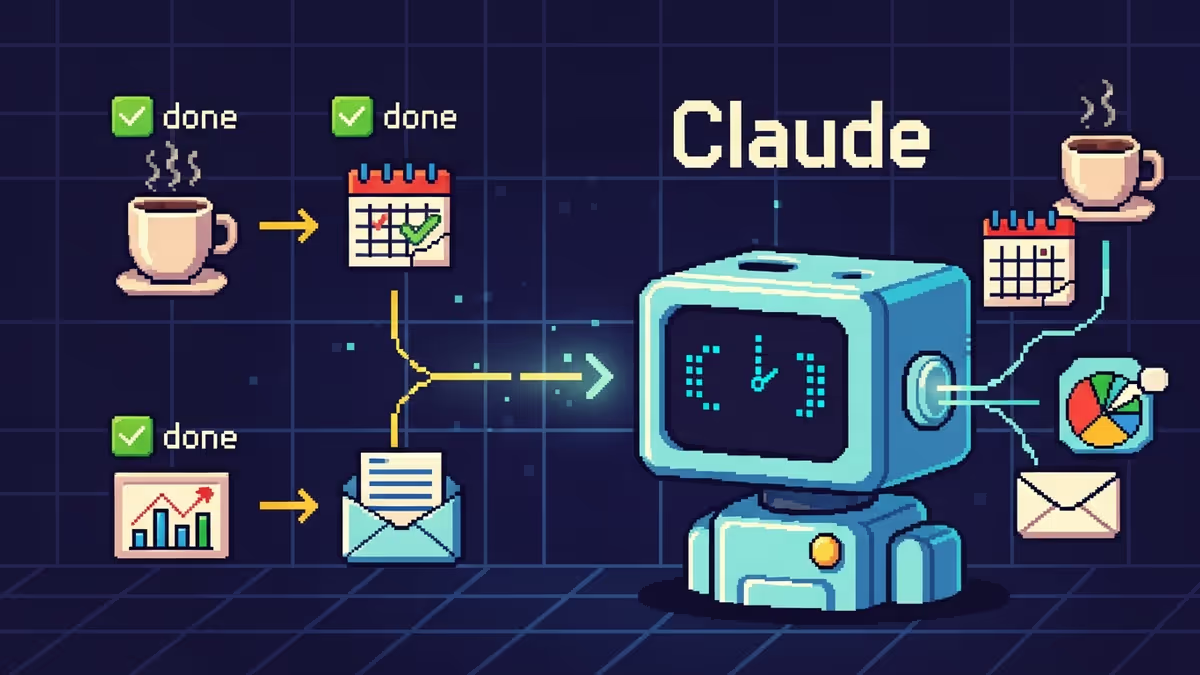

I subagents operano in una struttura gerarchica classica: vengono generati dall'agente principale, svolgono il loro compito e riportano i risultati esclusivamente al creatore. Non comunicano mai tra loro, non condividono informazioni se non attraverso il coordinatore centrale. È un modello efficiente per task ben definiti e sequenziali, dove la parallelizzazione serve principalmente a risparmiare tempo.

Gli Agent Teams, invece, introducono una comunicazione orizzontale. I teammate condividono una task list comune, si rivendicano autonomamente il lavoro e soprattutto comunicano direttamente tra loro senza dover passare dal team lead. Questa architettura peer to peer tra agenti AI è, a mio avviso, uno degli sviluppi più interessanti nel panorama dell'intelligenza artificiale applicata allo sviluppo software.

Quando la complessità diventa valore

La scelta tra subagents e Agent Teams non è neutra. Anthropic è molto chiara nel sottolineare che gli Agent Teams introducono un overhead di coordinamento significativo e consumano molti più token. Non sono quindi una soluzione universalmente superiore, ma uno strumento specializzato per scenari specifici.

Questo approccio onesto e pragmatico è rinfrescante. Troppo spesso nel mondo dell'AI assistiamo a generalizzazioni eccessive, dove ogni nuova funzionalità viene presentata come rivoluzionaria in ogni contesto. Qui invece c'è una consapevolezza esplicita dei trade off: gli Agent Teams brillano quando il lavoro può essere effettivamente parallelizzato con dipendenze minime tra i task, ma diventano controproducenti per lavori sequenziali o che richiedono modifiche concentrate su pochi file.

I casi d'uso che rivelano il potenziale

È nell'analisi dei casi d'uso consigliati che emerge la vera visione dietro gli Agent Teams. Non stiamo parlando di semplice automazione di task ripetitivi, ma di scenari che richiedono creatività, esplorazione parallela di ipotesi e sintesi di prospettive diverse.

Ricerca e review: l'intelligenza collettiva artificiale

Il primo scenario, la ricerca e review, è particolarmente affascinante. Immaginare più agenti che investigano simultaneamente aspetti diversi di un problema, per poi condividere e persino sfidare reciprocamente le proprie conclusioni, replica un processo tipicamente umano: il confronto dialettico come strumento di scoperta della verità.

Questo approccio ha implicazioni profonde. Non stiamo più chiedendo a un singolo agente di esplorare tutto lo spazio delle soluzioni possibili in sequenza, ma stiamo creando le condizioni perché prospettive diverse emergano naturalmente dalla parallelizzazione del lavoro. È un modello che ricorda da vicino il concetto di "diversity of thought" tanto valorizzato nei team umani ad alte prestazioni.

Debug con ipotesi concorrenti: accelerare la convergenza

Il caso del debugging con ipotesi multiple è quello che trovo più illuminante dal punto di vista metodologico. Quando ci troviamo di fronte a un bug complesso, raramente esiste un percorso lineare verso la soluzione. Testiamo teorie, le scartiamo, ne formuliamo di nuove. Con gli Agent Teams, questo processo di eliminazione può avvenire in parallelo: diversi teammate testano contemporaneamente teorie diverse e convergono sulla risposta più rapidamente.

Ciò che mi colpisce è come questo approccio trasformi intrinsecamente il modo in cui concepiamo il debugging. Non più un processo seriale di ipotesi e verifica, ma un'esplorazione parallela dello spazio delle possibilità che riduce drasticamente il tempo di convergenza verso la soluzione.

Le limitazioni che raccontano la maturità del progetto

Anthropic è straordinariamente trasparente riguardo le limitazioni degli Agent Teams, che sono esplicitamente dichiarate come sperimentali e disabilitate di default. Questa onestà è preziosa e rivela una maturità progettuale che va oltre l'hype.

Le limitazioni principali riguardano la ripresa delle sessioni, il coordinamento dei task e il comportamento in fase di shutdown. Sono problematiche tecniche non banali che emergono naturalmente quando si cerca di coordinare sistemi distribuiti, anche se questi sistemi sono agenti AI piuttosto che microservizi tradizionali.

Ciò che trovo interessante è come queste limitazioni riflettano sfide universali dell'informatica distribuita. Coordinare agenti autonomi che operano in parallelo, gestire lo stato condiviso, garantire un shutdown pulito: sono problemi che conosciamo bene dal mondo dei sistemi distribuiti classici. Vederli riemergere nel contesto degli Agent Teams è un promemoria che l'AI, per quanto avanzata, opera ancora all'interno dei vincoli fondamentali dell'informatica.

Implicazioni più ampie: verso team ibridi uomo macchina

Quello che gli Agent Teams di Claude Code rappresentano va oltre la specifica implementazione tecnica. Siamo di fronte a un esperimento su come potrebbero evolversi i team di lavoro del futuro, dove la distinzione tra collaboratori umani e agenti AI diventa sempre più sfumata.

La possibilità di interagire direttamente con i singoli teammate, senza dover passare attraverso il team lead, è particolarmente significativa. Suggerisce un modello dove l'umano non è più necessariamente il coordinatore centrale che delega e riceve report, ma può diventare un membro del team che interagisce alla pari con agenti AI specializzati.

Il costo dell'intelligenza distribuita

Non possiamo però ignorare l'elefante nella stanza: il consumo di token. Gli Agent Teams utilizzano significativamente più risorse computazionali rispetto a un singolo agente o ai subagents. In un contesto dove il costo computazionale dell'AI è già un tema centrale, questa moltiplicazione delle risorse necessarie solleva interrogativi sulla sostenibilità e scalabilità del modello.

Tuttavia, se guardiamo all'analogia con i team umani, il ragionamento cambia prospettiva. Assumere più persone per lavorare in parallelo costa più che assumerne una sola, ma per certi tipi di problemi è l'unico modo per ottenere risultati in tempi ragionevoli. La stessa logica potrebbe applicarsi agli Agent Teams: il costo aggiuntivo è giustificato quando la parallelizzazione porta a un valore che un singolo agente non potrebbe generare in tempi accettabili.

Il design che emerge dall'uso

Anthropic fornisce best practices molto specifiche su quando utilizzare gli Agent Teams, ma ciò che non può prescrivere è come emergeranno nuovi pattern d'uso dall'esperienza collettiva degli sviluppatori. Questo è forse l'aspetto più eccitante: stiamo assistendo alla nascita di un nuovo paradigma di interazione uomo AI, e i pattern definitivi emergeranno dall'uso reale.

Penso a come metodologie di sviluppo software come Scrum o Kanban non siano nate da specificazioni teoriche, ma dall'evoluzione delle pratiche di team reali che cercavano modi migliori di lavorare. Gli Agent Teams potrebbero seguire una traiettoria simile, dove le best practices definitive emergeranno dall'esperienza collettiva di migliaia di sviluppatori che sperimentano con questa nuova modalità di lavoro.

Una riflessione sul futuro del lavoro cognitivo

Gli Agent Teams di Claude Code non sono semplicemente una feature interessante di un tool di sviluppo. Sono una finestra su come potrebbe evolversi il lavoro cognitivo complesso nell'era dell'AI avanzata. L'idea di orchestrare team di AI che collaborano, si sfidano, convergono verso soluzioni, replica dinamiche profondamente umane in un contesto artificiale.

Ciò solleva domande affascinanti. Se possiamo creare team di AI che replicano le dinamiche collaborative umane, quali aspetti del lavoro di squadra umano rimangono insostituibili? La creatività? L'empatia? Il giudizio etico? O forse è proprio nell'ibridazione tra capacità computazionali dell'AI e sensibilità umana che risiede il futuro più promettente?

Conclusione: l'AI che smette di essere uno strumento

Ciò che trovo più profondo negli Agent Teams è come rappresentino un passaggio concettuale fondamentale. L'AI non è più concepita come uno strumento singolo, per quanto sofisticato, da utilizzare. Diventa invece un ecosistema di agenti che collaborano, una struttura organizzativa artificiale che replica i meccanismi del lavoro di squadra umano.

Questo passaggio da strumento a collega, da automazione a collaborazione, segna probabilmente l'inizio di una trasformazione più ampia nel modo in cui pensiamo al rapporto tra umani e intelligenza artificiale. Non più una relazione gerarchica di controllo, ma una partnership orizzontale dove agenti umani e artificiali contribuiscono secondo le proprie specificità.

Gli Agent Teams sono ancora sperimentali, hanno limitazioni chiare e casi d'uso specifici. Ma nel loro design intravedo qualcosa di più grande: un futuro dove la distinzione tra lavorare con l'AI e lavorare in team diventa sempre più sottile, dove orchestrare intelligenze artificiali diventa una competenza manageriale tanto importante quanto coordinare team umani.

E forse, alla fine, questo è il vero salto concettuale: smettere di pensare all'AI come tecnologia da dominare e iniziare a pensarla come ecosistema di intelligenze con cui collaborare. Gli Agent Teams di Claude Code potrebbero essere uno dei primi passi concreti in questa direzione.